«Мощный, выверенный, надежный» — слова, которые полностью отражают работоспособность и функциональность еще лучшего, усовершенствованного инструмента Netpeak Spider. И это без преувеличений, «паук» последней версии может дать фору многим стационарным программам и онлайн анализаторам. Не верите? Что ж, тогда переходите на сайт разработчика, где Netpeak Spider можно скачать бесплатно, а затем оценить его достоинства самостоятельно.

Что такое Netpeak Spider и чем он подкупает?

Netpeak Spider — это производительный легкий в применении софт, позволяющий выполнить анализ сайта и найти все возможные ошибки, которые затормаживают развитие веб-проекта.

Примечательно, что в отличие от предыдущей версии, обновленный Netpeak Spider не перегружает сервер хостинга, он стабилен в работе и невероятно шустрый.

Это отличное решение, обладающее широчайшими возможностями:

- Обнаружение ошибок в коде, неправильно настроенных перенаправлений, битых ссылок, дублирующего контента: страниц, title, description, заголовков H1 и т. д.

- Анализ входящих и исходящих ссылок.

- Определение критических ошибок внутренней оптимизации.

- Расчет внутреннего PageRank страниц для улучшения внутренней перелинковки.

- Тонкая настройка, позволяющая просканировать определенные части сайта.

- Выгрузка полученных данных в файлы для дальнейшей работы с ними в Excel.

- Обнаружение изображений, в которых не прописан атрибут ALT.

- Проверка времени и кода ответа сервера.

Производитель позиционирует свое творение, как профессиональный софт. И с этим нельзя не согласиться. Полученные данные нужно уметь интерпретировать и использовать. Не воспринимайте все найденные ошибки слишком серьезно, иначе вы загоните себя в тупик.

«Нетпик Спайдер» подойдет всем и каждому, кто старается держать свой веб-проект в ухоженном виде. Несмотря на обильное количество настроек, с основным функционалом справится даже начинающий сеошник.

Программа на 100 % русифицирована, что значительно упрощает работу. Краулер проверяет сайт на наличие более 100 ключевых ошибок внутренней оптимизации, анализирует, насколько проект соответствует основным SEO-параметрам.

Netpeak Spider — знакомство с «тарантулом»

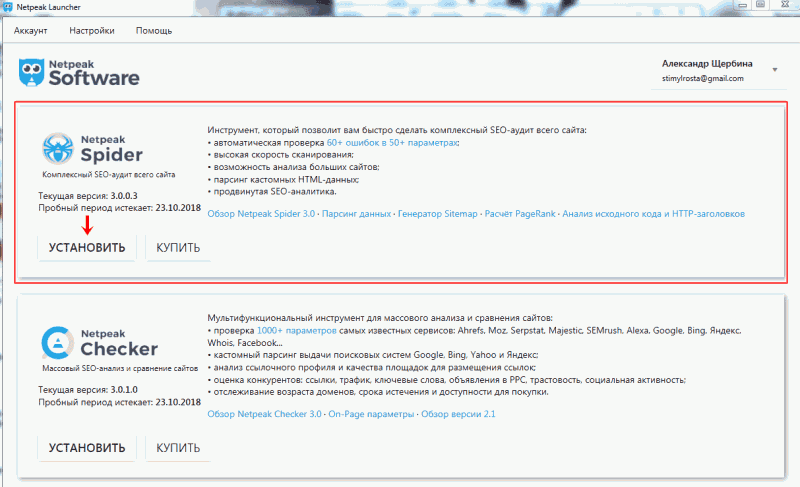

Чтобы ощутить на себе всю мощь модифицированного «паука», нужно посетить сайт разработчика, зарегистрироваться, а затем установить Netpeak Launcher — десктопную программу для управления продуктами Netpeak Software.

После установки лаунчера, откройте его и скачайте «Нетпик Спайдер».

Как работать с Netpeak Spider

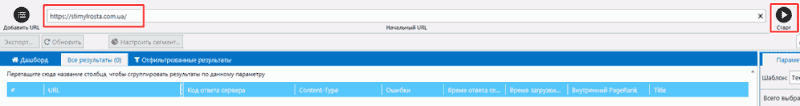

Теперь, когда программа установлена, остается ее запустить, указать в соответствующей строке доменное имя сайта, и нажать кнопку «Старт».

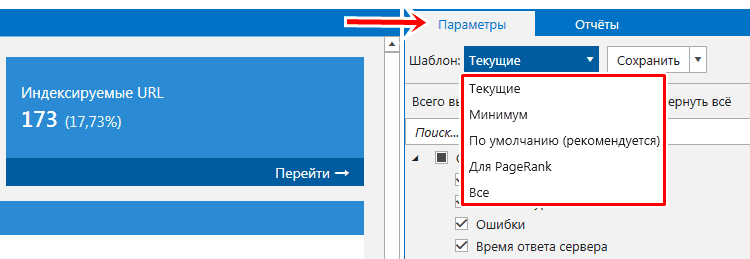

При желании можно задать условия обработки данных. Для этого перейдите в правую часть программы на вкладку «Параметры» и выберите один из предусмотренных шаблонов.

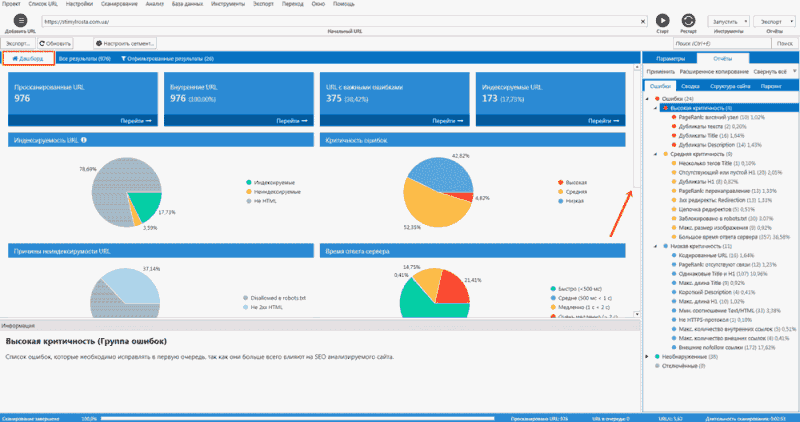

Время сканирования зависит от размера веб-проекта. Например, для сканирование 976 урлов моего сайта, «тарантулу» потребовалось чуть ли не три минуты.

В обновленную версию Netpeak Spider 3.0 разработчики внедрили замечательную фичу — возможность приостановить сканирование веб-ресурса и возобновить в любое удобное время. Для этого в процессе технического анализа кликните по кнопке «Пауза», сохраните проект (Ctrl+S) и при следующей активации программы, откройте сохраненный файл (Ctrl+O) и опять нажмите «Старт».

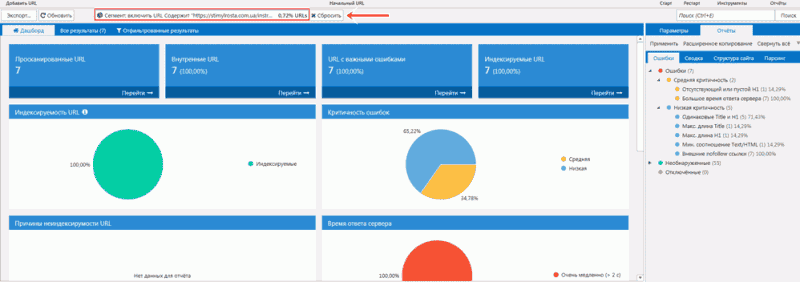

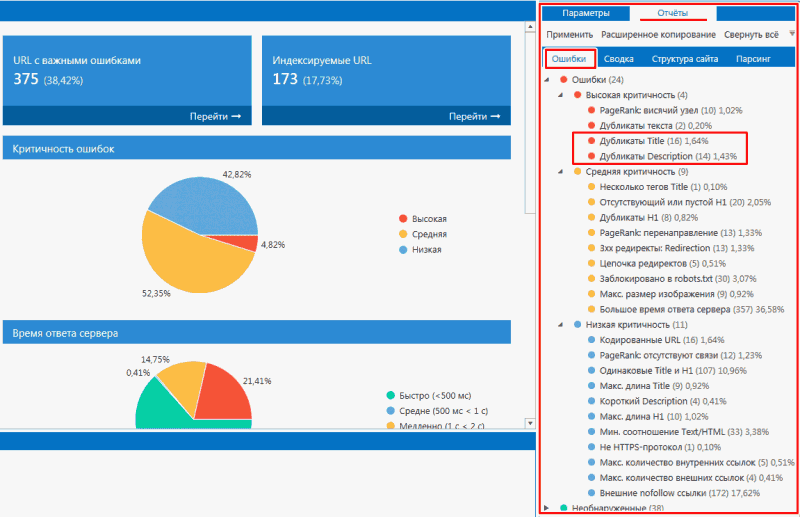

Дашборд

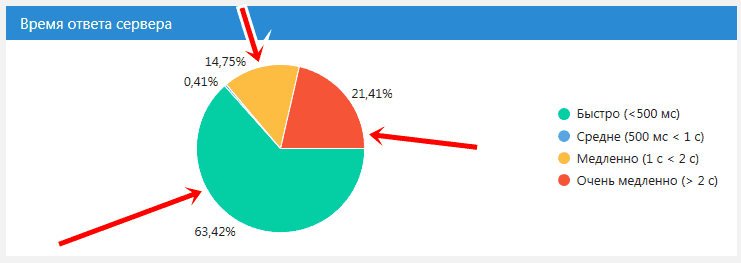

Во вкладке «Дашборд», расположенной в верхней левой части экрана отображается информация о количестве просканированных URL, внутренних и индексированных URL, URL с важными ошибками. Здесь же отображаются диаграммы, позволяющие ознакомиться с индексированием и причинами неиндексируемости, временем ответа сервера, типом контента, уровнем критичности ошибок.

Воспользуйтесь ползунком, чтобы проскроллить дашборд к низу, и ознакомиться с результатами проверки более детально.

Все диаграммы «Нетпик Спайдер» кликабельные, что способствует удобному ознакомлению с предоставленной информацией. Кликнув по определенному цвету диаграммы можно посмотреть, какие URL относятся к тому или иному типу проблемы.

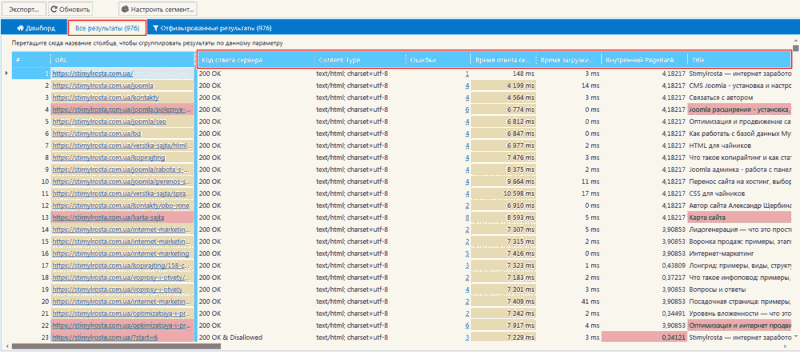

Все результаты

В этой вкладке результаты анализа отображаются в табличной форме. Заметьте, каждая строка относится к конкретному URL существующей странички, а колонки — это анализируемые параметры:

- код ответа сервера;

- тип контента;

- количество найденных ошибок;

- время ответа сервера;

- время загрузки контента;

- относительный вес страницы, рассчитанный по алгоритму PageRank;

- наличие тега title.

Чтобы было проще ориентироваться, какой URL нуждается в срочном «ремонте», критические ошибки отображаются на бледновато-красном фоне. Ошибки средней и низкой критичности указаны на желтом и синем фоне, соответственно.

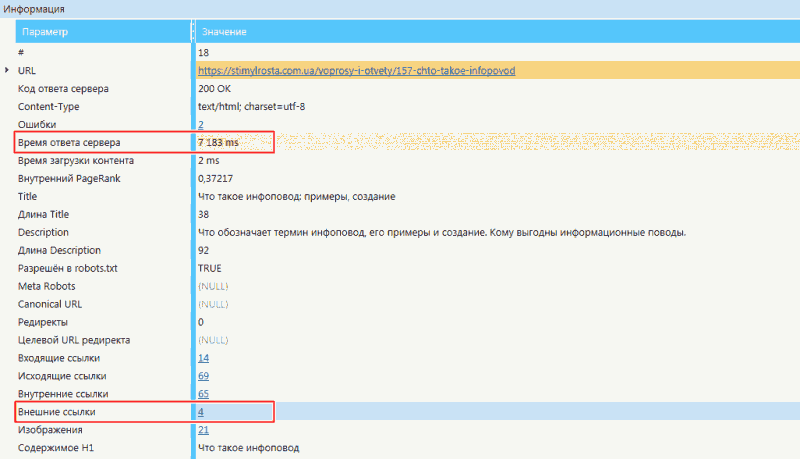

При нажатии по определенному URL отображается вкладка «Информация», где можно более подробно ознакомиться с результатами его сканирования. На отсканированном документе Netpeak Spider выявил две ошибки: слишком долгий ответ сервера и четыре внешние ссылки.

Из двух найденных погрешностей, внимания заслуживает только одна — продолжительное время ответа сервера. Проблема со ссылками, которая выделена синим маркером, вовсе не проблема. Это URL на новостную ленту Feedburner, которая закрыта от индексации тегом <noindex>. Как выше уже упоминалось, полученную информацию нужно уметь интерпретировать.

Вкладка «Отфильтрованные результаты» позволяет настроить фильтры, добавив необходимые условия. Преднастроенными фильтрами можно воспользоваться на вкладке «Дашборд» основной панели или на вкладке «Отчеты», расположенной в сайдбаре.

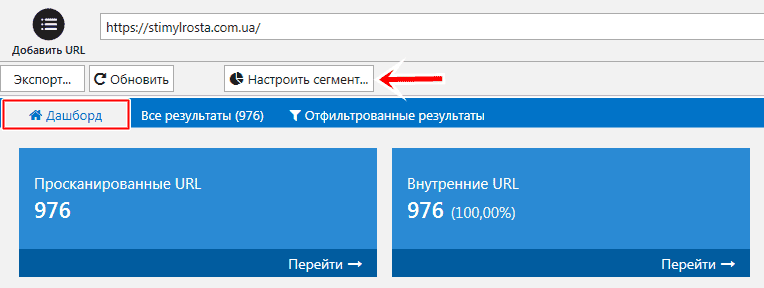

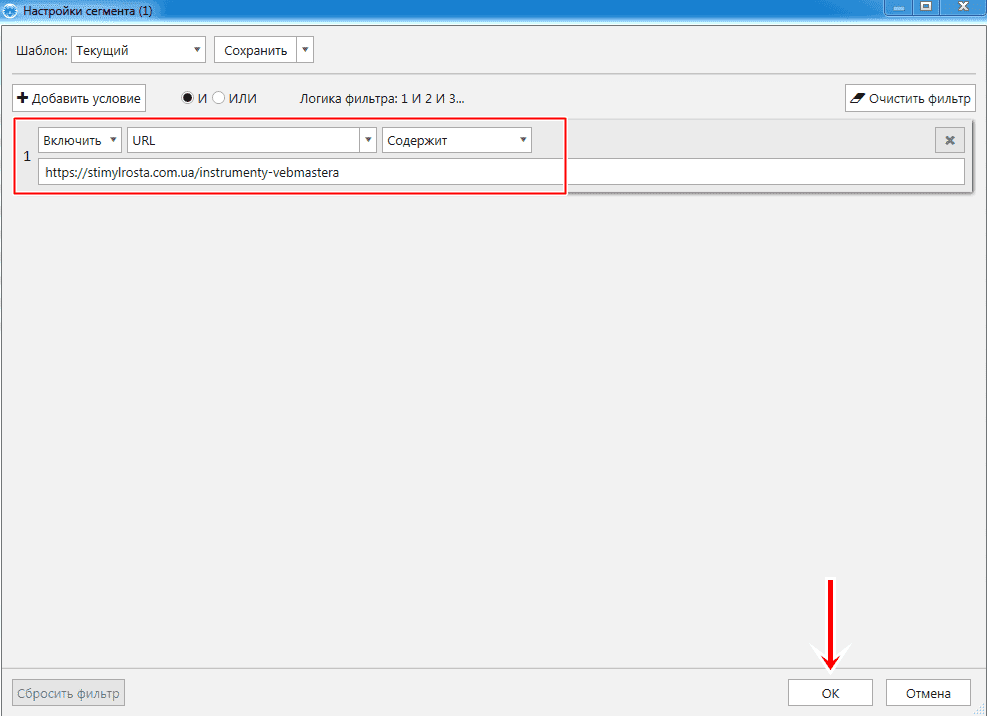

Если стоит необходимость изъять данные только по определенным URL, перейдите во вкладку «Настроить сегменты». Например, можно включить в отчет только материалы из категории «Инструменты вебмастера» сайта StimylRosta.

Чтобы это проделать, в настройках сегмента выберите условие «URL» оставьте значение «Содержит» по умолчанию, в нижеприведенное поле вставьте URL-адрес и нажмите кнопку «Ок».

После этого на дашборде и в отчетах отобразятся результаты сканирования ранее указанных страниц блога. Сегмент сбрасывается, нажатием на кнопку «Сбросить».

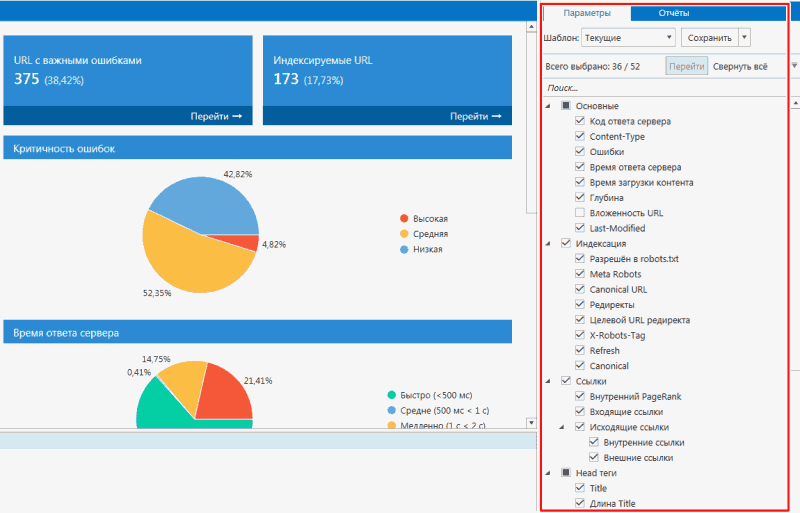

Netpeak Spider 3.0 — вкладка «Параметры»

Вкладка, как и вся информация по ней находится в правой части программы. Чтобы убрать или добавить параметры сканирования, достаточно убрать или поставить галочку напротив соответствующего значения.

Для большего удобства, параметры разделены на группы:

- Основные

- Индексация

- Ссылки

- Head теги

- Пагинация

- Контент

- Заголовки H1-H6

- Показатели

- Уникальные хеши

Netpeak Spider — вкладка «Отчеты»

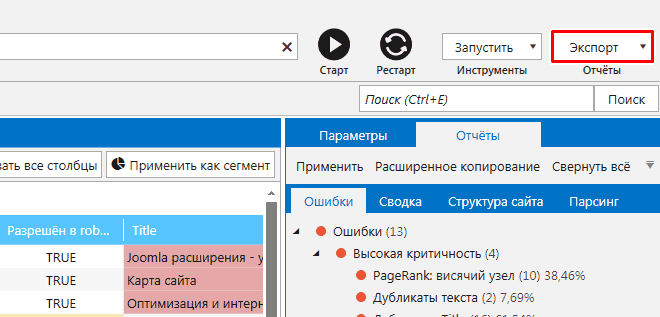

Расположены возле параметров. «Отчеты» состоят из четырех дочерних вкладок:

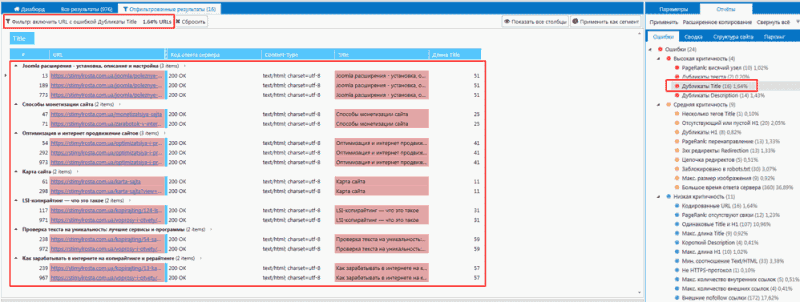

Ошибки

В верхней части списка на красном фоне отображаются критичные ошибки, ниже ошибки, не несущие большой угрозы.

Все пункты в списке кликабельные и позволяют ознакомиться с проблемой более детально.

Возьмем, например, «Дубликаты Title». Исходя из отчета, Netpeak Spider обнаружил у меня на сайте 16 дубликатов, и это очень печально. Кликаем по соответствующей ошибке и внимательно анализируем информацию, предоставленную в дашборде.

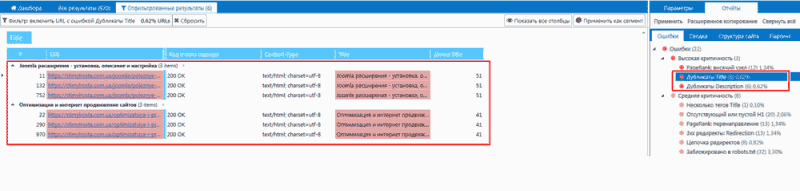

«Тарантул» нашел дублирующиеся заголовки, о существовании которых я не подозревал. Что ж, впечатляет! После внесения правок и очередной проверки количество дубликатов title удалось сократить до 6. На это ушло не более 5 минут. Как видите, программа реагирует на внесенные правки мгновенно.

Обратите внимание на скриншот, снизив дублирующиеся заголовки, у меня на сайте снизились дубликаты description. Это значит, что проблема была связана с теми же самыми URL.

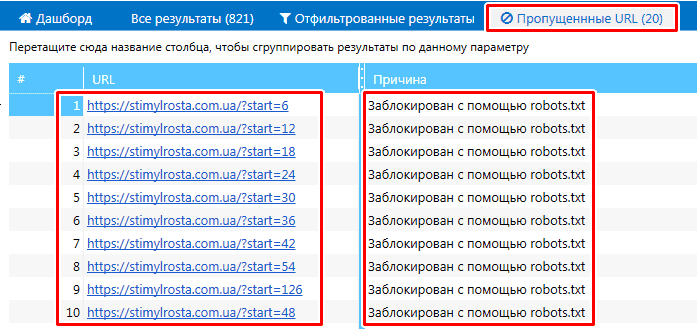

Мне показалось странным, что программа учитывает страницы, которые еще с основания сайта закрыты от индексации в файле robots.txt директивой:

Disallow: /?start*

Позже было обнаружено, что это мой косяк и на сайте появилось несколько корявых URL типа:

Disallow: /joomla/poleznye-sovety-i-rekomendatsii?start=ЦИФРА

Они образовались из-за особенностей CMS, которая автоматически генерирует новые страницы для категорий после их заполнения. Огромное спасибо разработчикам за наводку! В итоге я полностью избавился от дублирующихся title и description.

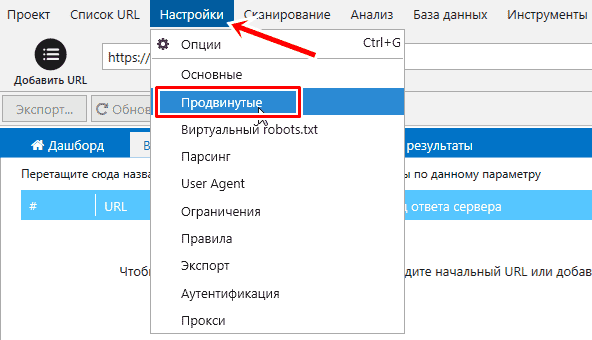

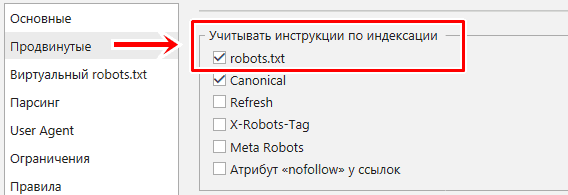

Чтобы посмотреть, какие URL запрещены для индексации в файле robots.txt нужно зайти в «Настроки/Продвинутые».

Отметьте галочку как на скриншоте для получения данных .

Таким образом, если отключить учет инструкций в robots.txt, то программа будет игнорировать эти запреты, и закрытые страницы попадут в общий отчет. Если же включить учет инструкций, то все закрытые страницы попадут на вкладку «Пропущенные URL».

Отфильтровать данные по определенным параметрам предоставляет возможность функция «Сегментация данных». Допустим необходимо отследить, на каких страницах присутствуют ошибки высокой критичности. Кликаем по соответствующей надписи, а затем нажимаем кнопку «Применить как сегмент». В итоге во вкладке «Дашборд» отобразятся отчеты об ошибках.

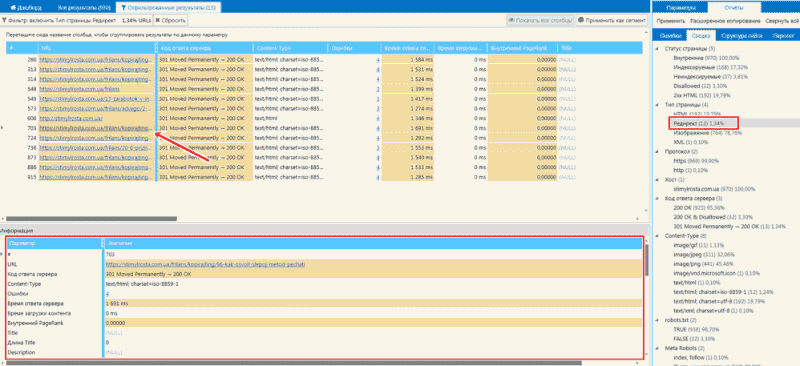

Сводка

Здесь можно посмотреть статус и тип страниц, протокол соединения, хост, код ответа сервера, глубину и т. д. Например, можно выбрать все страницы со статусом «Редирект». В отфильтрованных результатах можно просмотреть данные по конкретной странице с перенаправлением.

Структура сайта

Здесь находится сгруппированная информация о конкретном разделе сайта. Все данные также как и в вышеприведенном примере фильтруются.

Парсинг

Отображаются данные пользовательского парсинга, которые легко можно скопировать посредством функции «Расширенное копирование».

Для этого выберите отчет и кликните по кнопке «Расширенное копирование», откройте любую программу для работы с таблицами и нажмите сочетание клавиш «Ctrl+V» — вставить.

Также все проанализированные отчеты можно заполучить в формате .xlsx с помощью кнопки «Экспорт».

Программа сохраняет таблицу с отчетом на жестком диске ПК.

Особенно полезной является функция «Сохранить», которая находится во вкладке «Проект». При следующем открытии Netpeak Spider, сразу же откроются предыдущие результаты индексирования.

Итог

Вряд ли пользователей интернета привлекают «кривые» сайты. Поэтому многие интернет-маркетологи, SEO-специалисты и вебмастера выбирают программу Netpeak Spider. Это великолепный многофункциональный инструмент для оперативного комплексного SEO-аудита вашего сайта.

Обнаружили в тексте грамматическую ошибку? Пожалуйста, сообщите об этом администратору: выделите текст и нажмите сочетание горячих клавиш Ctrl+Enter